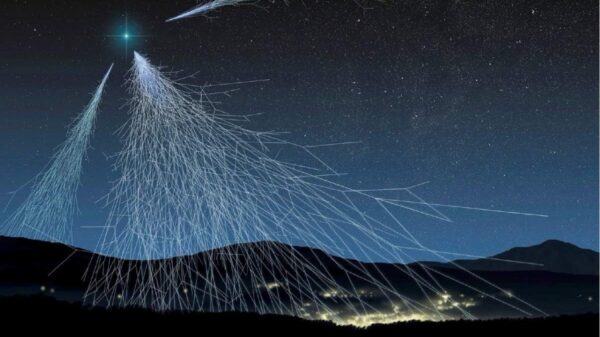

Investigadores de la Binghamton University (BU) y la State University of New York (SUNY) han desarrollado un sistema de Inteligencia Artificial (IA) destinado a mapear las interacciones entre el contenido y los algoritmos en las plataformas digitales, con el objetivo de reducir la propagación de contenido potencialmente dañino o engañoso. Este avance se presenta en un contexto donde las redes sociales han facilitado la difusión de información errónea, creando lo que se conoce como “cámaras de resonancia”.

La investigación, publicada el 17 de julio de 2025, destaca que los algoritmos que priorizan la interacción pueden amplificar contenido emocional o polarizador, facilitando la propagación de teorías conspirativas. Los autores del estudio sugieren que la implementación de este sistema de IA permitiría a los usuarios y operadores de plataformas como Meta o X identificar y eliminar fuentes de desinformación, así como promover la diversidad informativa.

Desafíos de la desinformación en la era digital

El coautor del estudio, Thi Tran, quien es profesor adjunto de sistemas de información de gestión en la Facultad de Administración de la BU, enfatiza que el entorno digital actual favorece la creación de ecosistemas informativos homogéneos. “Las personas crean la IA, y así como las personas pueden ser buenas o malas, lo mismo aplica a la IA”, afirmó Tran. “Por eso, si ves algo en línea, ya sea algo generado por humanos o por IA, debes cuestionarte si es correcto o creíble”.

El estudio también muestra cómo las plataformas digitales optimizan la entrega de contenido basado en métricas de interacción, lo que refuerza la tendencia de los usuarios a seleccionar información que confirma sus creencias preexistentes. Esto se evidenció en una encuesta realizada a 50 estudiantes universitarios que reaccionaron a afirmaciones erróneas sobre las vacunas contra la COVID-19. A pesar de que el 90% indicó que continuaría vacunándose, el 70% manifestó que compartiría la desinformación con amigos y familiares.

Una solución potencial para el futuro

Los hallazgos subrayan un aspecto crucial de la dinámica de la desinformación: aunque muchas personas pueden reconocer afirmaciones falsas, sienten la necesidad de buscar más pruebas antes de descartarlas por completo. “Todos queremos transparencia informativa, pero cuanto más expuesto estés a cierta información, más creerás que es cierta”, concluyó Tran. “Con esta investigación, en lugar de pedirle a un verificador de datos que verifique cada contenido, podemos utilizar la misma IA generativa que utilizan los ‘malos’ para difundir desinformación a mayor escala y reforzar el tipo de contenido en el que la gente puede confiar”.

El artículo de investigación titulado “Ecos Amplificados: Un Estudio de Contenido Generado por IA y Cámaras de Eco Digitales” fue presentado en una conferencia organizada por la Sociedad de Ingenieros de Instrumentación Fotoóptica (SPIE) y ha sido coescrito por otros académicos, incluyendo a Seden Akcinaroglu, profesor de ciencias políticas en Binghamton, y Nihal Poredi, estudiante de doctorado en ingeniería y ciencias aplicadas.