Meta acaba de revolucionar el mercado de gafas inteligentes al anunciar el lanzamiento de un kit para desarrolladores que permitirá crear aplicaciones para las gafas Ray-Ban Meta y las nuevas Ray-Ban Display.

En las últimas horas, la empresa tecnológica lanzó el Meta Wearables Devices Access Toolkit, una suite de herramientas que abrirá el acceso a los sensores integrados de sus gafas inteligentes, como cámara, micrófonos y altavoces. Esta noticia significa que cualquier desarrollador podrá crear experiencias móviles innovadoras utilizando las capacidades completas de los dispositivos.

Acceso anticipado y fase de pruebas hasta 2025

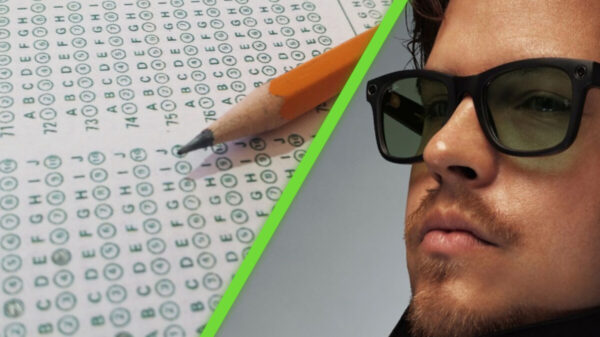

La inscripción para la fase de pruebas para desarrolladores ya está abierta y la compañía anticipa que estará disponible para finales de 2025. Durante esta etapa inicial, los desarrolladores podrán diseñar prototipos que integren funciones concretas, aunque sólo para una audiencia limitada a través del portal oficial de Meta.

Lo más importante es que esta primera versión del kit permitirá incorporar sensores, pero no incluirá funciones de inteligencia artificial (IA) ni comandos de voz, que llegarán en futuras actualizaciones. Tampoco estará disponible el acceso a la Meta Neural Band, ya que la empresa está enfocada en consolidar una base sólida para el desarrollo.

Usos y potencial de las gafas con IA

Meta presentó escenarios de uso innovadores: aplicaciones que aprovechen la cámara para crear experiencias en primera persona (POV), comunicación manos libres mediante micrófono y altavoces, y extensiones que transformen la interacción más allá de la pantalla del móvil. Esto posiciona a las gafas como dispositivos indispensables para la vida cotidiana, con tecnología avanzada y diseño al mismo tiempo, apuntando a una nueva era donde convergen estilo y funcionalidad.

El SDK soportará todos los modelos de gafas inteligentes con IA de Meta, incluyendo las Oakley Meta HSTN, Oakley Meta Vanguard y las recién anunciadas Ray-Ban Display. Los desarrolladores podrán integrar funciones usando los perfiles Bluetooth compatibles con iOS y Android.

¿Qué sigue para México y el mundo?

Para aprovechar plenamente el kit, los interesados deberán contar con unas gafas físicas, aunque el SDK incluye un simulador para empezar a desarrollar sin necesidad de hardware inmediato. La versión definitiva del kit llegará en 2026, momento en el que las aplicaciones podrán distribuirse generalmente.

Este movimiento abre una ventana única para desarrolladores mexicanos y globales que buscan innovar en tecnología portable. La apuesta de Meta no sólo democratiza la creación de apps para gafas inteligentes, sino que impulsa la integración de tecnología y estilo personal en la vida diaria, anticipando un cambio radical en el uso interactivo y móvil.

Meta: “Las gafas de IA se están convirtiendo en una parte integral de la vida cotidiana al hacer que la tecnología avanzada sea accesible para todos”.

En un mercado donde la innovación es esencial, este kit para desarrolladores coloca a Meta a la vanguardia con un ecosistema abierto que podría transformar la forma en que los mexicanos y el mundo usan dispositivos inteligentes en su día a día.

Próximamente, estaremos atentos a los avances en las capacidades de IA y a las nuevas funcionalidades que Meta irá incluyendo. Mientras tanto, los desarrolladores interesados pueden registrar su interés hoy mismo en la página oficial de Meta para prepararse para la llegada masiva de estas gafas inteligentes al mercado.