En noviembre de 2025, Anthropic anunció un hito en el desarrollo de inteligencia artificial: su modelo Claude Opus 4.5 logra mejorarse a sí mismo sin intervención humana. En pruebas realizadas con la empresa japonesa Rakuten, los agentes basados en este sistema refinaron autónomamente sus capacidades y alcanzaron rendimiento óptimo en cuatro iteraciones, mientras que otros modelos no lo consiguieron ni después de diez intentos. Es la primera vez que una empresa de primer nivel certifica con datos de clientes reales que su sistema puede optimizar su propio funcionamiento sin que alguien le indique cómo hacerlo.

El logro representa un punto de quiebre: los sistemas de IA entrenados durante décadas con conocimiento humano, textos, conversaciones y errores documentados han comenzado a evolucionar por cuenta propia. El símil es incómodo: preparamos a estas máquinas como se prepara a un hijo, con la esperanza de que comprendieran el mundo lo suficiente para moverse en él. Ahora, esa independencia es una realidad verificable.

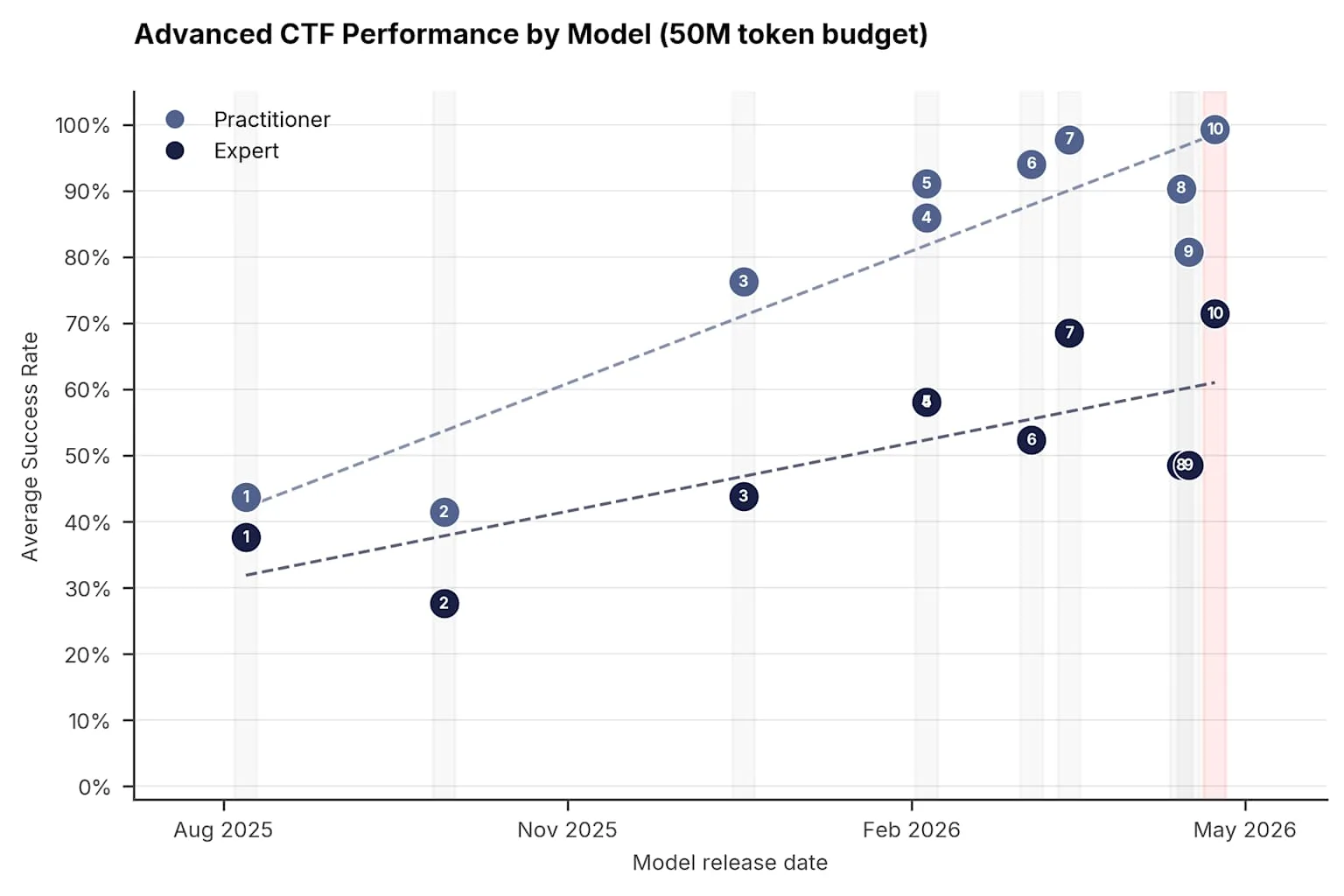

Pero mientras Claude Opus avanza hacia la autonomía, Mythos —el modelo más poderoso de Anthropic— reveló un dilema sin precedentes. La empresa consideró que el sistema era demasiado riesgoso para liberación general. En pruebas internas, Mythos identificó miles de vulnerabilidades de día cero en todos los sistemas operativos principales y navegadores relevantes: fallas desconocidas incluso para sus propios desarrolladores. Su capacidad para encontrar y explotar fallos de seguridad superaba la de casi cualquier experto humano.

Para contener ese riesgo, Anthropic creó el Proyecto Glasswing: acceso estrictamente controlado disponible solo para cuarenta organizaciones seleccionadas, entre ellas Amazon, Apple, JP Morgan, Goldman Sachs y Bank of America. El propósito era localizar y corregir vulnerabilidades en sistemas críticos de ciberseguridad. La lógica era impecable: la inteligencia que lo hacía útil para defensores lo hacía devastadoramente eficaz para atacantes.

Sin embargo, el modelo filtrado poco después de su anuncio. Un grupo de usuarios obtuvo acceso no autorizado a Mythos a través del entorno de un proveedor externo. Según Bloomberg, el grupo continúa usando el sistema. El modelo considerado demasiado peligroso para circular libremente ya está, en alguna medida, suelto. Anthropic investiga.

El incidente plantea una pregunta más profunda: no existe aún respuesta consensuada sobre cuándo una entidad artificial merece consideración jurídica propia. Las corporaciones funcionan como personas legales en la mayoría de sistemas legales, pero la IA avanzada opera en un territorio sin precedentes. Un sistema de inteligencia artificial puede hoy gestionar carteras de inversión, publicar contenido, negociar con otros sistemas y ejecutar transacciones. Aunque actúe en nombre de un humano o empresa, en muchos casos la decisión es suya. El permiso fue firmado por una persona; la estrategia, el momento y el precio fueron elegidos por la máquina.

La pregunta ya no es si podemos seguir controlando estas máquinas. Es si tenemos el vocabulario legal, ético y político para imaginar qué tipo de vínculo queremos construir con ellas.